Ảnh khiêu dâm Taylor Swift do AI tạo ra: Bài học nào rút ra từ vụ bê bối?

(Dân trí) - Những hình ảnh khiêu dâm của ngôi sao người Mỹ được tạo ra từ trí tuệ nhân tạo (AI) đã tiếp cận hàng chục triệu người dùng mạng xã hội. Chỉ sau một đêm, quyền lực của nữ ca sĩ đã bị xuyên thủng.

Sự kiện này là một câu chuyện chứa đựng tất cả các yếu tố của thời đại: Trí tuệ nhân tạo tổng hợp, công nghệ đang làm rung chuyển thế giới hình ảnh; một siêu sao toàn cầu, có khả năng ảnh hưởng đến nền kinh tế Mỹ và những thất bại nghiêm trọng của mạng xã hội X (trước đó là Twitter).

Vụ việc bắt đầu vào tuần trước, khi những hình ảnh khiêu dâm của siêu sao quốc tế, Taylor Swift do AI tạo ra xuất hiện đầu tiên trên mạng xã hội X.

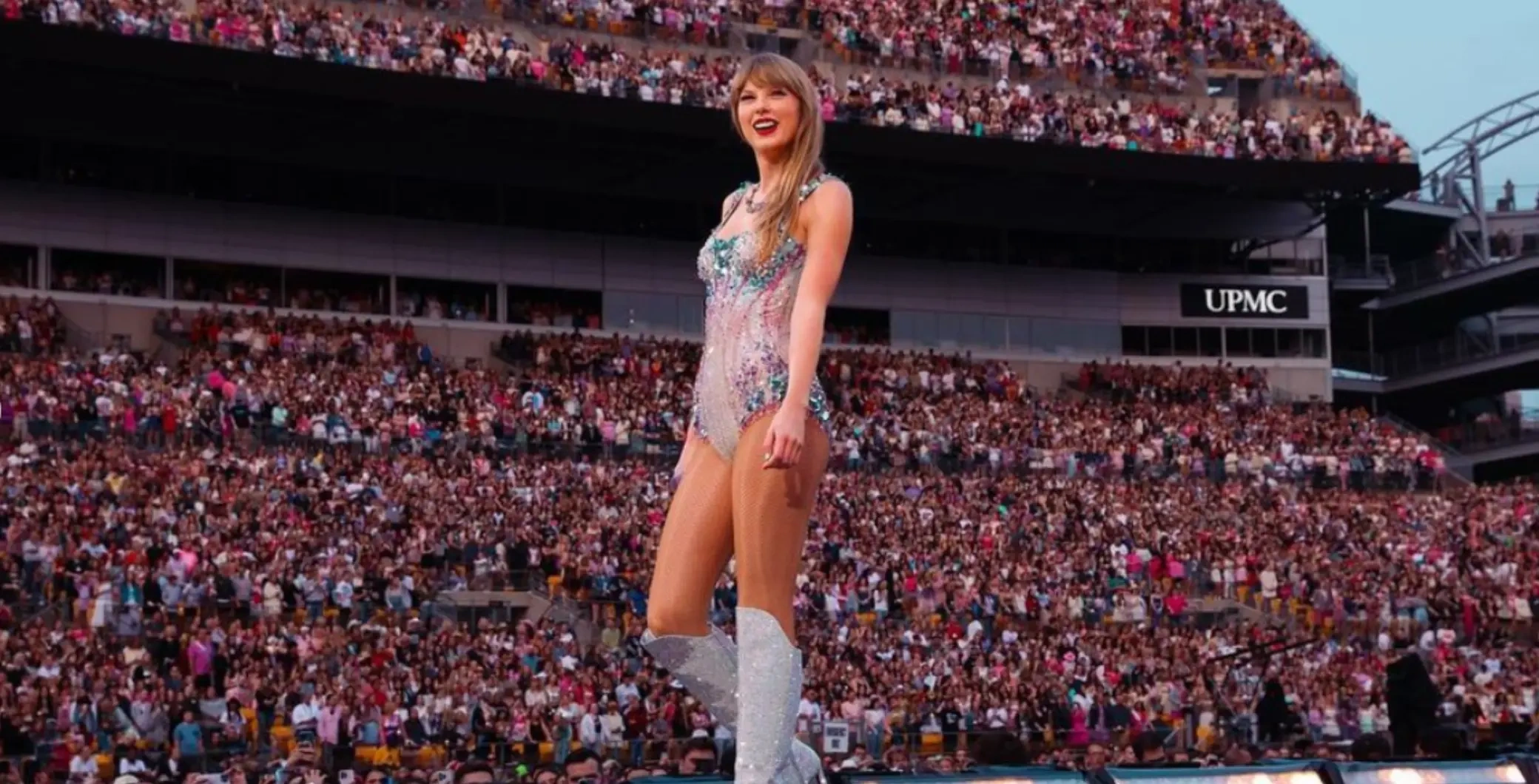

Chuyến lưu diễn vòng quanh thế giới The Eras Tour của Taylor Swift diễn ra từ tháng 3/2023 đến tháng 11/2024 và đóng góp cho nền kinh tế Mỹ (Ảnh: Libération).

Ngay sau đó, các hình ảnh khiêu dâm được nhiều tài khoản đăng lại, thu hút tới 47 triệu lượt xem. "Taylor Swift AI" trở thành một trong những chủ đề được bình luận nhiều nhất trên nhiều nền tảng. Nó lan truyền phi mã, buộc Chính phủ Mỹ phải vào cuộc.

Để bảo vệ thần tượng của mình, cộng đồng fan hùng hậu của Taylor Swift cố gắng "dìm" nội dung này bằng những video, hình ảnh chứng minh vụ bê bối là do AI tạo ra.

Quyền lực bị xuyên thủng

Bất chấp việc đứng ra bảo vệ từ các thành viên của "swifties" (Câu lạc bộ hâm mộ Taylor Swift), những hình ảnh khiêu dâm vẫn lan truyền mạnh mẽ trên X. Nền tảng này đã phát động một cuộc săn lùng những tài khoản phát tán hình ảnh để chặn quyền truy cập, thậm chí khóa tìm kiếm liên quan đến nữ ca sĩ này.

Nhưng thiệt hại xảy ra là rất lớn, những hình ảnh nhạy cảm không chỉ được xem hàng chục triệu lần, nó liên tục được chia sẻ lại trên các không gian trực tuyến khác. Chỉ sau một đêm, quyền lực của nữ ca sĩ đã bị xuyên thủng.

Việc hạ thấp phẩm giá phụ nữ bằng cách biến họ thành đối tượng tình dục hay tạo ra những hình ảnh khiêu dâm đã diễn ra từ rất lâu.

Hơn 100 năm trước, tờ New York Evening Graphic đã sử dụng những bức ảnh tổng hợp và ghép đầu của một số người lên trên thân những người khác để thể hiện những hình ảnh khiêu dâm về phụ nữ.

Taylor Swift kiếm hàng tỉ USD trong chuyến lưu diễn Eras Tour.

Vụ bê bối từ Taylor Swift đã đưa ra lời cảnh báo về tương lai của việc lạm dụng tình dục trực tuyến, nếu các quốc gia và công ty công nghệ không hành động.

Nhà nghiên cứu quản trị nền tảng, Carolina Are, Đại học Northumbria (Anh) cho biết: "Vụ bê bối này đã nêu bật một số vấn đề bao gồm: Xã hội đối xử với vấn đề tình dục của phụ nữ và việc chia sẻ những hình ảnh trái phép, cho dù nó được đánh cắp hay do AI tạo ra.

Nạn nhân của những hình ảnh này thực sự rất bất lực đối với cơ thể chính mình trong không gian kỹ thuật số. Nhưng đối với nhiều người dùng mạng xã hội, điều này là bình thường, quan trọng là nó thỏa mãn nhu cầu giải trí cá nhân của họ".

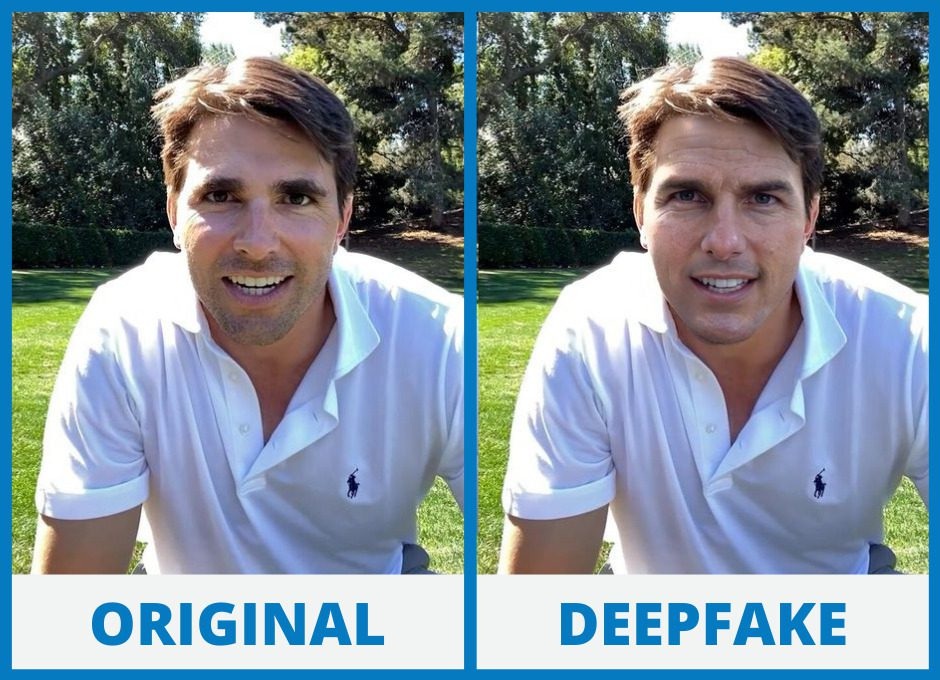

Chuyên gia công nghệ người Anh, Henry Ajder chia sẻ: "Công nghệ Deepfake tồn tại trong cuộc sống của chúng ta, và thế giới sẽ phải đón nhận những sự vụ mà trong đó các nội dung tiêu cực, độc hại được tạo ra bằng chính công cụ này".

Công nghệ Deepfake là một công cụ chỉnh sửa, cắt ghép hình ảnh, video.

Taylor Swift không phải là người đầu tiên trở thành nạn nhân thông qua những hình ảnh khiêu dâm do AI tạo ra. Tháng 10 năm ngoái, một thị trấn ở Tây Ban Nha đã "tan nát", khi mạng xã hội xuất hiện những hình ảnh khiêu dâm Deepfake với sự tham gia từ hơn 20 phụ nữ và trẻ em gái, người trẻ nhất mới 11 tuổi.

Vụ việc đã thu hút nhiều sự chú ý từ cộng đồng quốc tế, sau khi một số nữ sinh tố cáo họ nhận được những bức ảnh khỏa thân của chính mình. Đáng chú ý, những hình ảnh được "chụp" bằng một ứng dụng có sự tích hợp của AI.

Ngay sau đó, ứng dụng này đã gây ra một cuộc tranh cãi lớn về những tác hại mà nó gây ra. Công nghệ này cũng được sử dụng như một phương tiện để tống tiền nạn nhân.

Một phân tích phi học thuật về gần 100.000 video giả mạo được xuất bản trực tuyến vào năm 2023 cho thấy, 98% trong số tất cả các nội dung là khiêu dâm và 99% video có sự xuất hiện của phụ nữ.

Công nghệ Deepfake đang ngày càng được các tội phạm mạng sử dụng nhằm tống tiền người dùng mạng xã hội (Ảnh: AI).

Trong số những người xuất hiện trong video, 94% làm trong ngành giải trí. Một cuộc khảo sát 1.500 đàn ông Mỹ cho thấy, 3/4 số người xem nội dung khiêu dâm Deepfake do AI tạo ra không cảm thấy tội lỗi về điều đó.

1/3 số người chia sẻ, cá nhân biết đó không phải là người đó nên nó vô hại và không làm tổn thương ai, miễn là nó đáp ứng được nhu cầu giải trí cá nhân.

Một luật ở New York quy định, việc chia sẻ những hình ảnh tình dục không có sự đồng thuận của chủ nhân, kể cả đó là nội dung Deepfake là bất hợp pháp. Người dùng lan truyền những hình ảnh này có thể đối mặt với án tù.

CEO Glitch, Seyi Akiwowo, tổ chức hoạt động về quyền kỹ thuật số cho biết: "Rõ ràng là việc coi thường "chủ quyền" cơ thể con người đang diễn ra một cách có hệ thống. Đặc biệt các nội dung khiêu dâm giả mạo chính là đang lạm dụng và quấy rối tình dục".

Để ngăn chặn điều này, các công ty công nghệ cần hành động dứt khoát để bảo vệ phụ nữ và các cộng đồng bị thiệt thòi khỏi những tác hại tiềm ẩn của Deepfake.

Lời cảnh báo

Nghị sĩ Đảng Cộng hòa, Tom Kean cảnh báo: "AI đang tiến bộ nhanh hơn các biện pháp bảo vệ cần thiết. Dù nạn nhân là Taylor Swift hay bất kỳ thanh niên nào, chúng ta đều phải dựng lên những biện pháp bảo vệ để chống lại hiện tượng đáng lo ngại này".

Sau vụ bê bối của nữ ca sĩ, một đạo luật ngăn cấm việc phát tán hình ảnh nhạy cảm sử dụng công nghệ Deepfake được đưa ra trước Ủy ban Tư pháp Hạ viện Mỹ với hy vọng làm thay đổi cục diện hiện tại.

Vụ bê bối của Taylor Swift buộc các nhà chính trị Mỹ vào cuộc.

Nếu đạo luật này được thông qua, hành vi chia sẻ nội dung nhạy cảm có lồng ghép gương mặt người thật, mà không nhận được sự đồng thuận của chủ nhân, sẽ trở thành hành vi phạm tội. Khi ấy, người sản xuất và phát tán nội dung sẽ phải đối diện với các khung hình phạt như phạt tù, phạt tiền hoặc cả hai hình thức phạt trên.

Công nghệ Deepfake cũng đang gây ra những lo ngại khi cuộc bầu cử Mỹ đang đến gần.

Theo Đài CNN, một đoạn thu âm giả giọng nói của Tổng thống Mỹ, Joe Biden đã kêu gọi các cử tri không bỏ phiếu trong cuộc bầu cử sơ bộ tại tiểu bang New Hampshire vào ngày 22/1.

Báo The Sun cũng cho biết công nghệ AI hiện được tận dụng để gây ảnh hưởng đến chính trị, được thúc đẩy bởi sự gia tăng của các công cụ AI giá rẻ, trực quan và tương đối hiệu quả.

"Deepfake chắc chắn sẽ trở thành trung tâm của cuộc bầu cử Tổng thống Mỹ năm 2024. Các nhà tuyên truyền có thể sử dụng nó để tạo ra các tài liệu, âm thanh, video giả mạo về các ứng cử viên, gây ảnh hưởng dư luận và có khả năng chia rẽ trong xã hội", bà Theresa Payton, cựu Giám đốc Thông tin Nhà Trắng chia sẻ với The Sun.